Akademski skandal: Ostavka profesora zbog lažnih AI citata

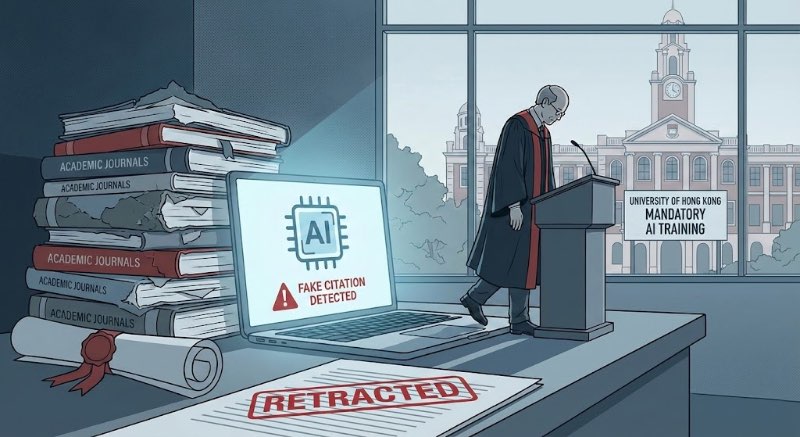

Veštačka inteligencija (AI) se sve više percipira kao moćan asistent u istraživačkom radu, sposoban da ubrza analizu podataka i pregled literature. Međutim, nedavni događaji su oštro osvetlili i potencijalne zamke njene upotrebe. U visokoprofilnom slučaju akademskog nepoštenja, profesor sa jednog od 11 najboljih svetskih univerziteta morao je da podnese ostavku, stvarajući priču upozorenja iz koje ceo akademski svet može izvući ključne pouke.

Pouka 1: Čak ni elitne institucije nisu imune

Incident se dogodio na Univerzitetu u Hong Kongu (HKU), koji je rangiran kao 11. najbolji na svetu prema QS World University Rankings za 2026. godinu. Ovaj detalj je od izuzetnog značaja – pokazuje da problemi akademskog integriteta povezani sa veštačkom inteligencijom nisu ograničeni na manje poznate institucije, već se mogu pojaviti i na najvišim nivoima akademske zajednice. Kao odgovor, univerzitet je uveo obaveznu obuku i procenu za sve istraživače o pravilnoj upotrebi AI.

HKU ponovo potvrđuje svoju posvećenost rigoroznim akademskim i istraživačkim standardima... Svi istraživači na HKU su obavezni da osiguraju da njihov rad ispunjava međunarodno priznate standarde kvaliteta i etičkog ponašanja.

Pouka 2: Odgovornost ne zaobilazi seniore: 'Nisam znao' više nije odbrana

U centru skandala našao se profesor Paul Yip Siu-fai, ali je važno razumeti njegov status. Profesor Yip nije samo cenjeni akademik; on je istaknuta javna ličnost u Hong Kongu, sa uticajnim savetodavnim i liderskim ulogama u vladinim telima, posebno u oblastima javnog zdravlja, prevencije samoubistava i obrazovanja. Upravo taj javni ugled čini ovaj slučaj još značajnijim, jer narušava poverenje javnosti koje je temelj uticaja svakog eksperta.

Ključno je istaći da je on bio dopisni autor (corresponding author), a ne glavni autor koji je koristio AI alat. Njegov doktorski student, Bai Yiming, bio je taj koji je koristio veštačku inteligenciju za pomoć pri referenciranju i propustio je da proveri citate. Uprkos tvrdnji profesora Yipa da je za problem saznao tek nakon što su optužbe počele da kruže internetom, suočio se sa ozbiljnim profesionalnim posledicama. Podneo je ostavku na pozicije prodekana Fakulteta društvenih nauka i člana istraživačkih odbora na nivou fakulteta i univerziteta, što naglašava težinu odgovornosti koju snose seniorni akademici koji nadgledaju istraživanja.

Pouka 3: sistem ima mrtav ugao: I reškuautori i izdavači su propustili g

Ovaj slučaj je otkrio sistemski propust. Nisu samo autori ti koji su prevideli lažne reference. Rad pod naslovom "Četrdeset godina tranzicije fertiliteta u Hong Kongu" sadržao je najmanje 20 nepostojećih publikacija među 61 navedenom referencom. Izdavač časopisa, Springer Nature, takođe je propustio da uoči netačne citate tokom svog uredničkog procesa i povukao je rad tek nakon što je problem javno iznet na internetu. Ovo ukazuje na to da trenutni procesi akademske verifikacije možda nisu opremljeni za jedinstvene izazove koje postavlja sadržaj generisan veštačkom inteligencijom, ostavljajući ranjivost koja je u ovom slučaju jasno razotkrivena.

Zaključak: Nova era akademske odgovornosti

Pouke su jasne: nijedna institucija nije imuna na pretnje koje AI postavlja akademskom integritetu, odgovornost se proteže sve do najviših, seniornih istraživača, a ceo sistem akademskog izdavaštva mora hitno da se prilagodi novoj realnosti. Ovaj incident nije samo priča o jednom propustu, već signal za celu akademsku zajednicu da preispita svoje standarde u doba veštačke inteligencije.

Kako AI postaje sve integrisaniji u svaku fazu istraživanja, ko na kraju snosi odgovornost za njegove greške – korisnik, mentor, institucija ili sama veštačka inteligencija?

Izvor: VnExpress

Komentari

Nema komentara. Šta vi mislite o ovome?