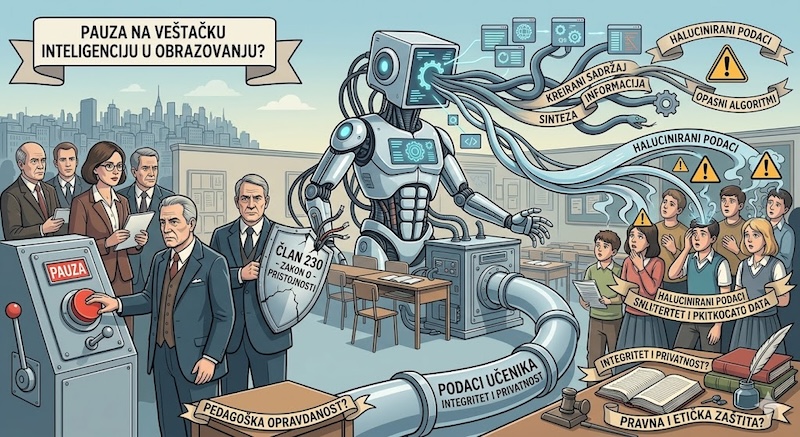

Edukatori bi trebali ozbiljno razmotriti pauzu u korišćenju veštačke inteligencije u učionicama

Dok se prašina slegne nakon nedavnih sudskih presuda koje bi mogle fundamentalno promeniti odgovornost tehnoloških kompanija, prosvetni radnici i školski administratori suočavaju se sa kritičnim trenutkom: da li je vreme da se pritisne dugme za pauzu kada je u pitanju veštačka inteligencija (AI) u obrazovanju?

Decenijama su tehnološke kompanije uživale široku zaštitu prema Članu 230 Zakona o pristojnosti u komunikacijama, koji ih je uglavnom štitio od odgovornosti za sadržaj koji postavljaju korisnici. Međutim, nedavna presuda Trećeg okružnog apelacionog suda u slučaju Anderson protiv TikToka promenila je pravila igre. Sud je utvrdio da algoritmi koji aktivno preporučuju sadržaj — u ovom slučaju, opasni "izazov gušenja" koji je doveo do smrti desetogodišnje devojčice — nisu samo pasivni kanali, već predstavljaju sopstveni "govor" kompanije.

Ova promena u pravnom pejzažu ima duboke implikacije za škole koje su požurile da integrišu generativnu AI u svoje nastavne planove i programe.

AI nije neutralan alat

Godinama su škole uvodile AI alate pod maskom inovacija, često bez potpunog razumevanja načina na koji ovi algoritmi funkcionišu. Generativna AI ne samo da pruža informacije; ona ih kurira, sintetizuje i, u mnogim slučajevima, "halucinira" ili kreira netačne podatke.

Kada škola usvoji AI alat koji usmerava učenika ka određenim izvorima ili oblikuje njihove argumente, ona više ne koristi neutralnu alatku. Ona koristi tehnologiju koja aktivno utiče na kognitivni razvoj i kritičko mišljenje učenika. Ako sudovi sada smatraju da su algoritmi preporuka oblik uredničkog izražavanja, škole bi se mogle naći u pravno nesigurnom položaju ako ti alati proizvedu štetan, pristrasan ili netačan sadržaj.

Pitanje privatnosti i bezbednosti podataka

Pored pravne odgovornosti, tu je i neprestani problem privatnosti. AI modeli se hrane podacima. Svaka interakcija koju učenik ima sa AI četbotom doprinosi ogromnom rezervoaru podataka koji se koriste za obuku budućih modela. U obrazovnom okruženju, ovo postavlja ozbiljna pitanja o tome ko poseduje intelektualnu svojinu učenika i kako se njihovi podaci štite od potencijalne zloupotrebe u budućnosti.

Štaviše, brzina kojom se AI razvija daleko prevazilazi sposobnost školskih okruga da uspostave adekvatne zaštitne mehanizme. Nastavnici su često prepušteni sami sebi da utvrde da li je neki alat bezbedan ili pedagoški opravdan, što stvara neujednačeno i potencijalno rizično okruženje za učenike.

Poziv na oprez

Zagovaranje pauze nije poziv na ludizam ili potpuno odbacivanje tehnologije. To je poziv na odgovornost. Pre nego što nastavimo sa masovnom implementacijom, moramo odgovoriti na ključna pitanja:

- Pedagoška opravdanost: Da li AI zaista poboljšava ishode učenja ili samo služi kao prečica koja slabi veštine dubokog razmišljanja?

- Transparentnost algoritama: Da li obrazovne institucije razumeju kako AI alati donose odluke i koje pristrasnosti prenose na decu?

- Pravna i etička zaštita: Ko snosi odgovornost kada AI alat pruži štetne informacije ili prekrši privatnost učenika?

S obzirom na to da se pravni okvir menja i da raste svest o rizicima koje donose nekontrolisani algoritmi, prosvetni radnici imaju dužnost da stanu i procene situaciju. Bezbednost i kognitivni integritet učenika moraju biti prioritet u odnosu na tehnološki trend današnjice.

Pauza bi omogućila kreatorima politika, nastavnicima i roditeljima da postave standarde koji će osigurati da AI služi obrazovanju, a ne da ga podriva.

Izvor: thehill.com

Komentari

Nema komentara. Šta vi mislite o ovome?