Šta je inferenca i zašto je to najvažnija reč u svetu AI?

Nedelja, 5. april 2026. 12:00

Autor: Dragan Tanaskoski

Tagovi: Šta je, Inferenca

Ako pratite vesti o veštačkoj inteligenciji, verovatno ste primetili da se termin inferenca (zaključivanje) pominje skoro jednako često kao i samo „učenje“ modela. Ali, šta to zapravo znači u praksi?

Najjednostavnije rečeno, inferenca je faza u kojoj AI model zapravo radi svoj posao.

Razlika između učenja (treninga) i inference

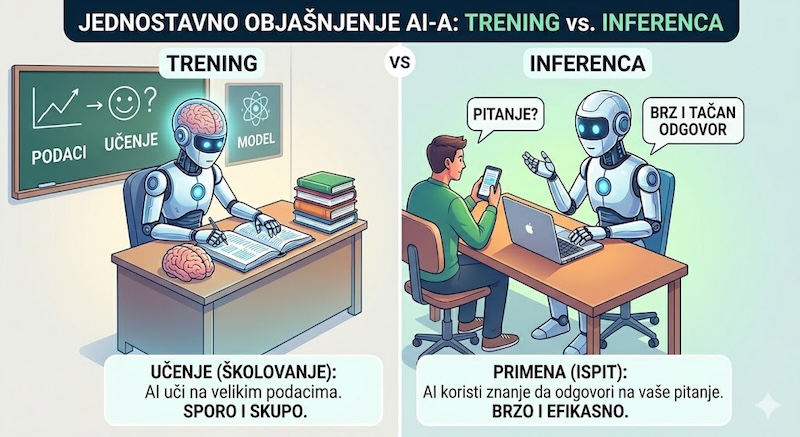

Da bismo razumeli inferencu, najbolje je da je uporedimo sa školovanjem:

-

Trening (Učenje): Ovo je proces u kojem AI „ide u školu“. Model proučava ogromne količine podataka, uči gramatiku, prepoznaje lica ili razume programski kod. To je izuzetno skup i spor proces koji zahteva hiljade moćnih grafičkih čipova.

-

Inferenca (Primena): To je trenutak kada AI „izađe na ispit“ ili dobije konkretan zadatak u realnom svetu. Svaki put kada ChatGPT-u postavite pitanje, on vrši inferencu da bi vam odgovorio. On koristi ono što je naučio da bi doneo zaključak o novom podatku koji mu je upravo stigao.

Zašto je efikasna inferenca ključ uspeha?

Dok se model trenira jednom u nekoliko meseci, inferenca se dešava milijardama puta dnevno. Svaki put kada AI „razmišlja“, to troši struju i serversko vreme, što direktno utiče na troškove kompanije. Zbog toga su inženjerima najvažnije tri stvari: brzina (latencija), cena i tačnost.

Primer iz prakse: Kako je Shopify „pobedio“ sistem

Sjajan primer optimizacije inference vidimo kod giganta u e-trgovini, kompanije Shopify. Oni su donedavno koristili najmoćniji OpenAI model (GPT-5) za izvlačenje podataka o milionima svojih trgovaca. Međutim, shvatili su da je takav „monolitni“ pristup preskup i spor.

Umesto jednog ogromnog modela, uveli su sistem sa više specijalizovanih agenata (multi-agent framework) i prešli na model otvorenih težina Qwen 3 koji hostuju na sopstvenim serverima.

Rezultat je bio frapantan:

-

Troškovi inference su smanjeni za čak 75 puta.

-

Kvalitet odgovora je udvostručen.

Ovo pokazuje da budućnost AI-a nije samo u posedovanju „najvećeg“ modela, već u tome koliko pametno i efikasno taj model koristi resurse tokom svakodnevnog rada – odnosno, tokom inference.

Detaljnije o tome kako je Shopify postigao ove rezultate možete pročitati OVDE.

Komentari

Nema komentara. Šta vi mislite o ovome?