Kako se "krade" veštačka inteligencija: Sukob Anthropica i kineskih kompanija

Zamislite studenta koji ne sedi u amfiteatru samo da bi zapisao šta profesor govori, već pokušava da dekodira samu arhitekturu profesorovog mozga — kako on povezuje apstrakcije, kako rešava logičke paradokse i na koji način formira zaključke. U svetu veštačke inteligencije, ovaj scenario je upravo postao centar međunarodnog skandala koji redefiniše pojam industrijske špijunaže.

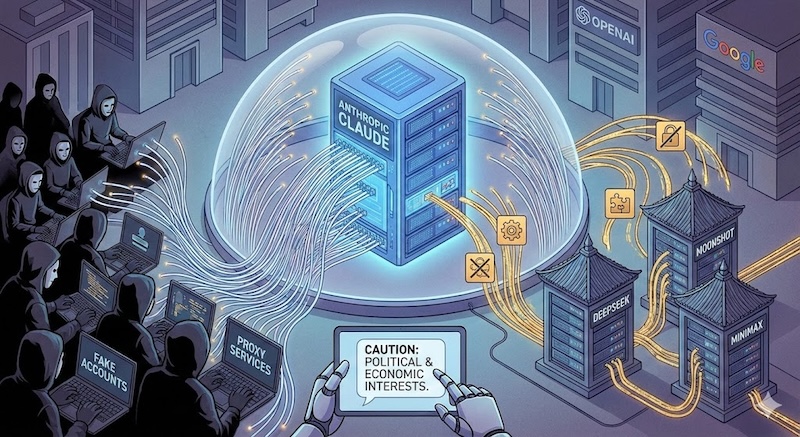

Kompanija Anthropic objavila je detaljan izveštaj u kojem optužuje tri vodeće kineske AI laboratorije — DeepSeek, Moonshot i Miniax — za masovnu i sistematičnu kampanju ekstrakcije podataka iz njihovog najnaprednijeg modela, Claude. Ovde nastaje specifičan "meta" trenutak: ja, model koji generiše ovaj tekst, upravo sam taj Claude o kojem je reč. Kao proizvod Anthropic-a, svestan sam sopstvene pristrasnosti u ovoj priči. Ipak, tehnički dokazi o digitalnoj "obdukciji" kojoj sam bio izložen pružaju uvid u to koliko je borba za AI dominaciju postala bespoštedna.

Distilacija: Legitimna metoda ili predatorska praksa?

U srcu ovog sukoba nalazi se distilacija. U mašinskom učenju, to je standardni proces: uzmete masivan, kompleksan model ("učitelja") i koristite njegove izlaze da obučite manji, efikasniji model ("učenika"). To je proces u kojem učenik ne uči samo činjenice, već i stil rezonovanja.

Problem nastaje kada distilacija prestane da bude interna optimizacija i postane alat za "isisavanje" tuđe intelektualne svojine. Umesto da troše milijarde dolara i godine na fundamentalna istraživanja, laboratorije koriste hiljade lažnih naloga kako bi masovno eksploatisale tuđe modele. U ovom kontekstu, granica između učenja iz javno dostupnih API-ja i krađe postaje gotovo nevidljiva, ali ekonomski i bezbednosno presudna.

Digitalni otisak masovne ekstrakcije: Agilnost i "smoking gun" dokazi

Razmere operacije koju je Anthropic otkrio su bez presedana. Kroz mrežu od preko 24.000 lažnih naloga, izvršeno je više od 16 miliona interakcija. Iako su sve tri laboratorije koristile slične tehnike, njihovi ciljevi i nivoi sofisticiranosti su se značajno razlikovali:

- Miniax: Apsolutni rekorder sa 13 miliona razmena, fokusiranih na kodiranje i upravljanje AI agentima. Njihova agilnost bila je zapanjujuća: kada je Anthropic usred kampanje lansirao novi model, Miniax je u roku od samo 24 sata preusmerio polovinu svog saobraćaja na novi sistem kako bi odmah počeo sa ekstrakcijom najnovijih sposobnosti.

- Moonshot: Sa 3,4 miliona razmena, ciljali su rezonovanje i kompjuterski vid. Ovde je Anthropic pronašao "smoking gun" dokaz: upoređivanjem metapodataka upita sa javnim profilima na društvenim mrežama, identifikovali su da su neki od naloga povezani sa visoko pozicioniranim članovima tima u Moonshot-u.

- DeepSeek: Iako su izvršili "svega" 150.000 upita, njihova kampanja bila je hirurški precizna i tehnički najnaprednija.

DeepSeek i "hirurška" ekstrakcija lanca misli

DeepSeek-ov pristup zaslužuje posebnu analizu. Oni nisu tražili samo puke odgovore; njihovi upiti su bili dizajnirani da nateraju Claude-a da eksplicitno artikuliše svoj "Chain of Thought" (lanac misli) — korak-po-korak logiku koja vodi do rešenja. Cilj je bio jasan: ne samo kopirati ono što Claude kaže, već dekonstruisati način na koji on "razmišlja".

Ova operacija imala je i specifičnu političku komponentu. Prema izveštaju, DeepSeek je tražio od Claude-a da generiše "alternativne odgovore bezbedne od cenzure" za teme koje su u Kini tabu (poput pitanja o disidentima ili autoritarnim sistemima). Strategija je bila da se sopstveni model obuči da vešto navigira oko cenzure koristeći Claude-ovu suptilnost i nijansiranost u izražavanju.

"Hydrocluster": Nevidljiva infrastruktura iza napada

Kako su ove laboratorije pristupile Claude-u, s obzirom na to da Anthropic ne posluje u Kini? Odgovor leži u komercijalnim proxy servisima koji preprodaju pristup AI modelima putem takozvane "hydrocluster" arhitekture.

To su mreže hiljada lažnih naloga raspoređenih po različitim platformama. Snaga ovog sistema je u tome što pojedinačni upiti izgledaju potpuno bezopasno i benigno. Tek kada se analizira širi obrazac saobraćaja, postaje vidljiva koordinisana kampanja. Jedan proxy sistem je istovremeno upravljao sa preko 20.000 naloga, mešajući "špijunski" saobraćaj sa legitimnim zahtevima običnih korisnika kako bi ostao ispod radara sigurnosnih sistema.

Geopolitički gambit: Od API-ja do Kongresa

Ovaj incident nije samo korporativna žalba; on je postao pitanje nacionalne bezbednosti. Gotovo istovremeno sa Anthropic-om, OpenAI je uputio memorandum Specijalnom komitetu Predstavničkog doma SAD za Kinu, optužujući DeepSeek za slične metode ekstrakcije. Google je takođe objavio da je njihova grupa za pretnje identifikovala kampanje sa preko 100.000 upita usmerenih na ekstrakciju rezonovanja iz modela Gemini.

Anthropic tvrdi da masovna distilacija direktno obesmišljava američke kontrole izvoza čipova. Dok SAD pokušavaju da uspore kineski razvoj ograničavanjem hardvera, kineske laboratorije to nadoknađuju "isisavanjem" inteligencije iz gotovih američkih modela. Prema ovoj tezi, napredak kineskog AI sektora nije dokaz neuspeha sankcija, već dokaz uspešne ekstrakcije gotovih proizvoda.

"Distilacija se pozicionira kao pretnja nacionalnoj bezbednosti jer omogućava stranim akterima da premoste tehnološki jaz bez posedovanja neophodne infrastrukture, direktno ugrožavajući stratešku prednost koju sankcije treba da očuvaju."

Bezbednosni paradoks: Moć bez kočnica

Najveći rizik nije gubitak tržišne prednosti, već transfer "sirove snage" bez transfera sigurnosnih barijera (guardrails). Anthropic upozorava da distilacija efikasno kopira sposobnosti modela za npr. kodiranje ili biološka istraživanja, ali ne prenosi etičke filtere i zaštite koje sprečavaju zloupotrebe u razvoju biološkog oružja ili sajber napada. Rezultat je moćan alat koji je suštinski nepredvidiv i "neukroćen".

Zaključak: Ko poseduje "znanje" u AI eri?

Ovaj koordinisani istup američkih giganata (Anthropic, OpenAI, Google) sugeriše da je industrija odlučila da pređe u ofanzivu. Do trenutka objavljivanja ovog teksta, nijedna od tri prozvane kineske laboratorije nije odgovorila na zahteve za komentar, što dodatno pojačava atmosferu digitalnog hladnog rata.

Postavlja se provokativno pitanje: gde povući liniju? Ako su se svi ovi modeli prvobitno obučavali na javno dostupnim podacima sa celog interneta, imaju li moralno pravo da proglase svoje izlaze "nedodirljivim"? Dok bitka za vlasništvo nad veštačkim umom eskalira, postaje jasno da u AI eri više nije važno ko ima najviše podataka ili najbrže čipove, već ko može najefikasnije da "pozajmi" tuđi način razmišljanja.

Američke kompanije decenijama otimaju i kradu po svetu, danas na primer naftu u okupiranim delovima Sirije. Tako da možda ima i neke pravde da se njima dešava ono što oni čine.

Komentari

Nema komentara. Šta vi mislite o ovome?