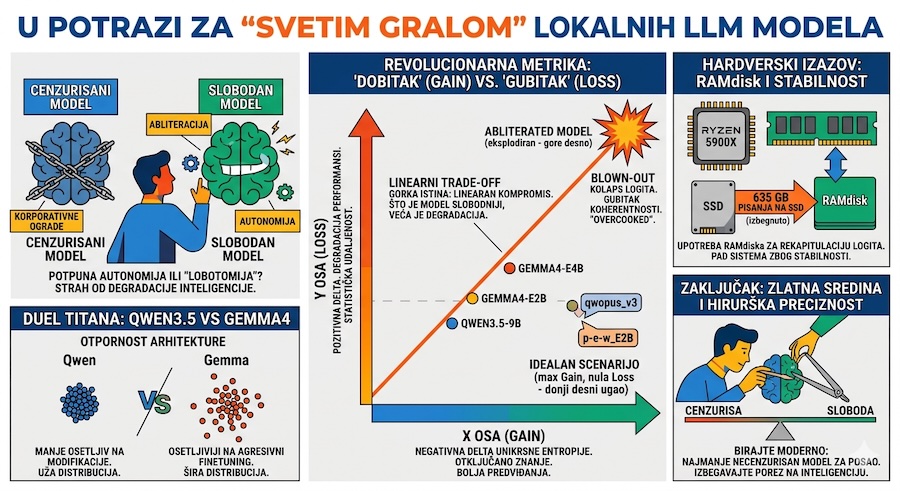

U potrazi za "svetim gralom" lokalnih jezičkih modela (LLM), korisnici često teže potpunoj autonomiji: modelu koji je oslobođen korporativnih zaštitnih ograda, ali koji zadržava kognitivnu oštrinu svog baznog izvornika. Međutim, u zajednici entuzijasta tinja opravdan strah – da li procesi poput "abliteracije" (uklanjanja odbijanja) zapravo vrše lobotomiju nad inteligencijom modela? Da li je moguće otključati potisnuto znanje bez kolapsa logičke strukture?